Crypto-beveiliging in 2026: Waarom deze 5 tips nu belangrijker zijn dan ooit

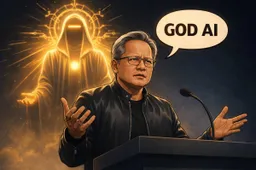

De scams worden slimmer, sneller en vooral veel geloofwaardiger. Waar we vroeger nog vrij makkelijk nep-Telegram-admins of slecht gespelde phishing-mails konden herkennen, zien we nu deepfake-video’s van bekende crypto-beroemdheden die je live aanmoedigen om snel je ETH over te maken.

AI maakt het tegenwoordig mogelijk om in minuten een nep-Elon, nep-Vitalik of nep-CZ in elkaar te draaien die perfect klinkt én eruitziet. En het probleem? Het werkt.

AI maakt het tegenwoordig mogelijk om in minuten een nep-Elon, nep-Vitalik of nep-CZ in elkaar te draaien die perfect klinkt én eruitziet. En het probleem? Het werkt.

Steeds vaker lezen we verhalen van mensen die tienduizenden euro’s kwijtraakten omdat “die ene bekende” hen persoonlijk een “unieke kans” tipte.

De nieuwe generatie scams in vogelvlucht

- Voice cloning + deepfake video: Iemand belt je met de stem van je favoriete YouTuber of zelfs van een familielid. Tegelijk zie je op een tweede scherm een video van die persoon die precies hetzelfde zegt.

- Hyper-realistische phishing sites: AI genereert in seconden complete websites die niet van de echte exchange te onderscheiden zijn – inclusief werkende 2FA-pagina’s en bewegende grafieken.

- Social engineering op steroïden: AI-scrapers halen in no-time je hele online leven bij elkaar: waar je over tweet, welke projecten je liket, welke vrienden je hebt. De scam-berichten voelen dan plotseling heel persoonlijk.

- Fake airdrops & support-chats: Bots die 24/7 in Discord en Telegram hangen en reageren alsof ze echte medewerkers zijn. Ze gebruiken context uit eerdere berichten om je vertrouwen te winnen.

Praktijk voorbeelden

1. Deepfake phishing (impersonation 2.0)

Dit is momenteel de meest effectieve methode. Hackers gebruiken AI om de stem en het gezicht van bekende CEO's of influencers in real-time na te bootsen.

- De methode: Slachtoffers worden benaderd via video-calls of "live" streams op YouTube en X waarin een AI-kloon hen overtuigt om tokens naar een 'secure wallet' te sturen of deel te nemen aan een valse weggeefactie (giveaway).

- Elon Musk deepfakes: In de tweede helft van 2025 en begin 2026 zijn er honderden AI-gestuurde streams gesignaleerd. Eén specifieke campagne leverde oplichters in korte tijd meer dan $5 miljoen op.

- Coinbase Customer Service scam: In december 2025 werd een netwerk opgerold (waaronder de verdachte Ronald Spektor) dat gebruikers opbelde met AI-stemmen die exact leken op Coinbase-medewerkers. Ze maakten hiermee circa $16 miljoen buit.

- Nout Wellink: Zelfs buiten de directe crypto-bubbel werden deepfakes van bekende economen zoals Wellink gebruikt om Nederlandse beleggers in "AI-trading bots" te lokken.

2. AI-gestuurde Contract Exploits

Hackers gebruiken nu gespecialiseerde AI-agents (zoals aangepaste versies van LLM's) om kwetsbaarheden in smart contracts te vinden die menselijke auditors over het hoofd zien.

- De methode: Waar een menselijke hacker dagen nodig heeft om code te analyseren, scant een AI-agent binnen seconden duizenden contracten op "edge cases" in de wiskunde van een protocol.

- Yearn Finance (december 2025): Een zogenaamde 'legacy' pool werd leeggetrokken voor $9,3 miljoen. De aanval werd mogelijk gemaakt door een AI-agent die een fout vond in de share-berekeningslogica die al jaren onopgemerkt was gebleven.

- Bybit exploit (februari 2025): De grootste digitale roof uit de geschiedenis (~$1,5 miljard) wordt deels toegeschreven aan geavanceerde, AI-ondersteunde infiltratietechnieken door staatsactoren (zoals de Lazarus Group).

Wat kun je concreet doen in 2026?

- Nooit meer zomaar op video of stem vertrouwen: Als iemand je dringend vraagt iets te doen – hoe bekend die persoon ook is – hang op en check het via officiële kanalen (niet via de link of het nummer dat ze je geven).

- Hardware wallet + air-gapped signing blijft koning: Zelfs als je browser of telefoon volledig gecompromitteerd is, kan een aanvaller zonder je fysieke handtekening niets beginnen.

- Gebruik een aparte “crypto-telefoon” of burner: Veel slachtoffers werden via hun normale telefoon of laptop benaderd. Een goedkoop apart toestel met alleen crypto-apps maakt het een stuk lastiger.

- Whitelisting op exchanges activeren: Bij de meeste grote platforms kun je tegenwoordig alleen naar goedgekeurde adressen sturen. Kost een paar minuten, maar scheelt een wereld aan zorgen.

- Verifieer altijd via meerdere wegen: Krijg je een bericht van “support”? Niet reageren in die chat. Ga rechtstreeks naar de officiële site/app en open een ticket. Altijd.

De harde realiteit

AI-scams gaan niet meer weg. Ze worden alleen maar goedkoper en toegankelijker. Wat nu nog een beetje amateuristisch oogt, is over twee jaar waarschijnlijk niet meer van echt te onderscheiden zonder dure forensische tools.

Voor de meeste mensen betekent dit: of je wordt een stuk wantrouwender, of je wordt een statistiek. Hoe hou jij jezelf scherp in deze nieuwe scam-wereld? Heb je zelf al eens een hele overtuigende AI-poging voorbij zien komen? Laat het weten hieronder!

Stop met te veel betalen voor je crypto. Bij de Amsterdamse exchange Finst handel je tegen de laagste tarieven van Nederland, zonder verborgen kosten.

👀 Bekijk Finst nu ›Let op: Beleggen in crypto brengt risico’s met zich mee. Handel alleen met geld dat u kunt missen.

Ga verder met lezen

Dit vind je misschien ook leuk

Laat mensen jouw mening weten

Lees ook

Populair Nieuws

Loading